前回の記事でプロビジョニング済みモデルのデプロイについてご紹介しましたが、今回はGPT-4oで利用できるグローバル標準のデプロイについて書きます。

概要

Azure OpenAI Serviceではいくつかのモデルのデプロイ方法が用意されており、グローバル標準はGPT-4oで利用できるデプロイ方法になります。

Azure OpenAI Serviceのデプロイのタイプ

| Global-Standard(GPT-4oのみ) | Standard | Provisioned | |

|---|---|---|---|

| データの所在地 | 特定できない | 特定できる | 特定できる |

| 課金モデル | トークン単位の支払い | トークン単位の支払い | 月単位のコミットメント |

| 料金 | 安価 | 安価 | 高価 |

| 負荷分散 | 対応 | 非対応 | 非対応 |

| 処理能力 | TPMが多い | TPMが少ない | TPUを必要に応じて追加できる |

Azure OpenAI Service のデプロイの種類について - Azure AI services | Microsoft Learn

グローバル標準とは

グローバル標準ではスタンダードと異なり、世界中のデータセンターにルーティングして負荷分散することができます。その反面、データがどのリージョンで処理されるのかはわかりません。

また、Azure OpenAI Serviceでは監査のためにデータを30日間保持されます。

グローバル標準では以下の記述の通り、東日本リージョンでデプロイした場合の監査データの所在は東日本リージョンになります。

保存されたデータは指定された Azure の地理的な場所に留まりますが、推論のためのデータ処理は任意の Azure OpenAI の場所で実行される可能性があります。

グローバル標準のスタンダードに対するメリットデメリットを整理すると以下になります。

- メリット

- 負荷分散でルーティングされる

- TPMが大きい

- 東日本リージョンでデプロイできる

- デメリット

- データが処理される地域が固定されない

- TPMが小さい

デプロイ方法

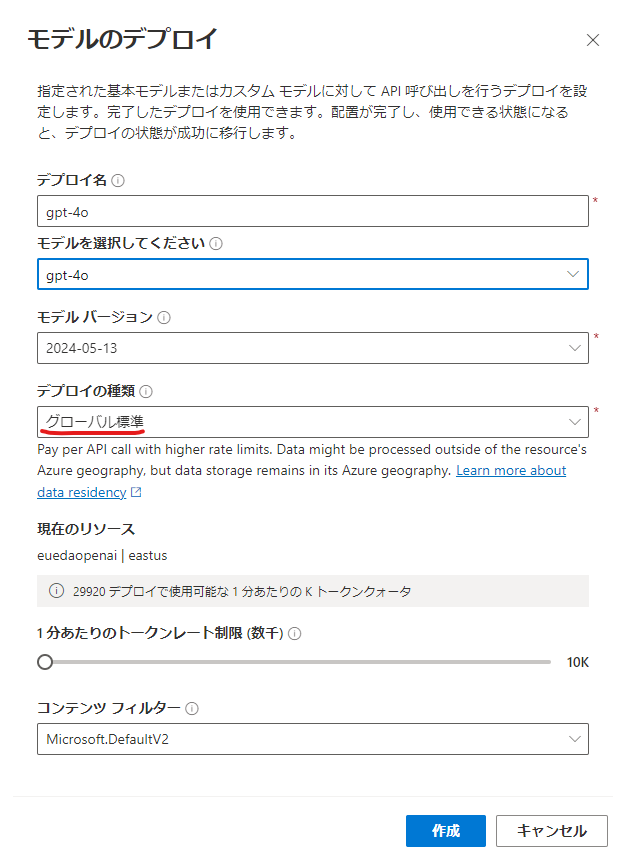

デプロイ方法は非常に簡単で、「デプロイの種類」で「グローバル標準」を選択するだけです。

ベンチマークでの比較

前回と同様に、こちらのGitHubで公開されているベンチマークツールを使用して、ベンチマークを比較しました。

GitHub - Azure/azure-openai-benchmark: Azure OpenAI benchmarking tool

モデル比較

| モデルバージョン | GPT-4o standard | GPT-4o global standard | GPT-4o global standard |

|---|---|---|---|

| リージョン | EastUS | EastUS | JapanEast |

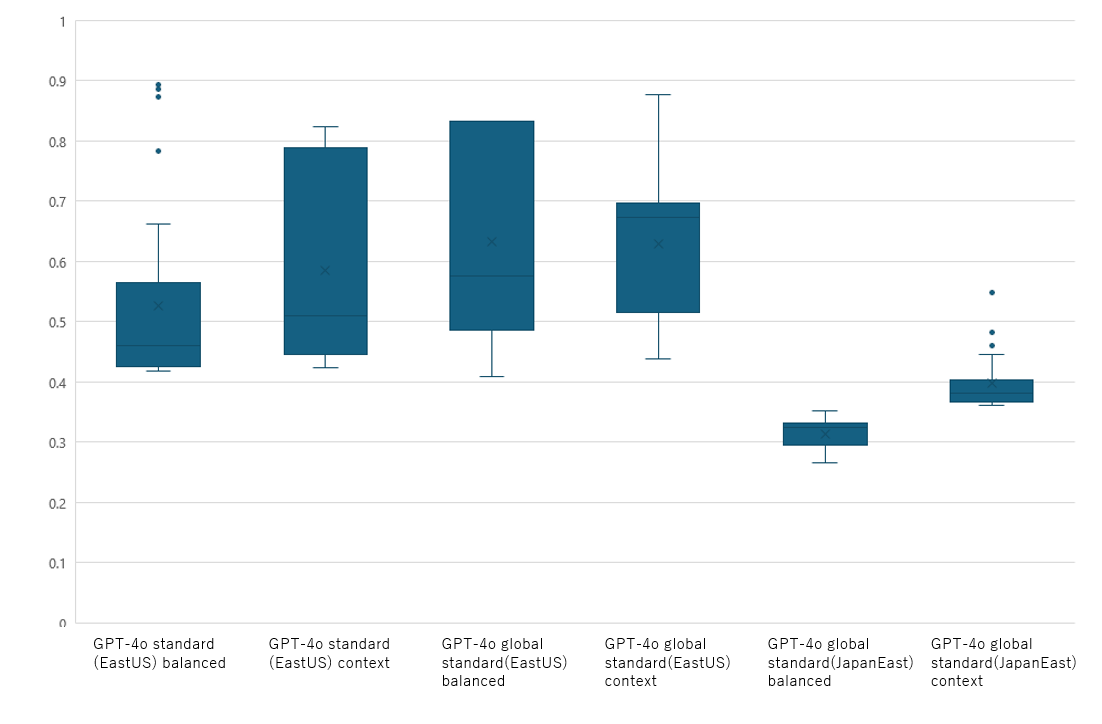

指標

ベンチマークツールのttft_avg:リクエストの開始から、最初のトークンが受信されるまでの平均時間(秒) で比較しました。

テスト項目と結果

それぞれのモデルにbalancedとcontextの2つを使い、それぞれのモデルでテストしました。

| GPT-4o standard (EastUS) balanced |

GPT-4o standard (EastUS) context |

GPT-4o global standard (EastUS) balanced |

GPT-4o global standard (EastUS) context |

GPT-4o global standard (JapanEast) balanced |

GPT-4o global standard (JapanEast) context |

|

|---|---|---|---|---|---|---|

| リージョン | EastUS | EastUS | EastUS | EastUS | JapanEast | JapanEast |

| context tokens | 500 | 2000 | 500 | 2000 | 500 | 2000 |

| max tokens | 500 | 200 | 500 | 200 | 500 | 200 |

| 時間帯 | 17時ごろ | 17時ごろ | 17時ごろ | 17時ごろ | 17時ごろ | 17時ごろ |

| リクエスト数 | 44 | 34 | 40 | 34 | 35 | 42 |

| 失敗リクエスト数 | 5 | 0 | 14 | 8 | 5 | 4 |

| 平均時間(秒) | 0.52 | 0.58 | 0.63 | 0.62 | 0.31 | 0.39 |

| エラー率 | 11.36% | 0% | 35% | 23.52% | 14.28% | 9.52% |

箱ひげ図

東日本リージョンのほうが早く安定したレスポンスがあったという結果となりました。

まとめ

GPT-4oなど最新のモデルは、スタンダードのデプロイでは東日本リージョンが使えないのですが、グローバル標準であれば利用する事が可能です。

データ処理の地域を許容できれば速度も安定しているので、グルーバル標準を東日本にデプロイする事も選択の一つと考えます。

上田 英治(日本ビジネスシステムズ株式会社)

エンジニアとしてインフラ構築、システム開発やIoT基盤構築等を経験し、現在はクラウドアーキテクトとして先端技術の活用提案や新規サービスの立ち上げを担当。

担当記事一覧